| 教授。光速って、どうやって測定しているんですか?? | |

| 現在ですか?? | |

| そうです。 | |

| 測定してませんよ。光速は基本定数として\(c\)=299,792,458m/sと決められているのです。 | |

| え??そうなんですか?? | |

| 寧ろ、その光速を用いて、長さの方を定義しているんですよ。 | |

| でも、歴史的にいろいろな人が光速を求めるチャレンジをしてますよね?? | |

| はい。Einsteinが登場するまで、まさか光速がどの慣性系においても不変だとは思いもしなかったでしょうからね。一番最初に光速の測定にチャレンジしたのはGalileoだと言われています。 | |

| 福山雅治?? | |

|

それはテレビ・ドラマ。Galileoは"近代科学の父"とも言われている物理学者です。 Galileo Galilei(1564~1642) Galileoは、稲光が上から下へ走る様子を見て、光速は有限ではないか、ということに気が付きます。そこで、2点間の距離と、光がその間を往復する時間を計測するというアイデアで光速を求めようとしました。  図1.5.1 Galileoの方法 | |

| オーソドックスな方法ですね。でも、人間の運動神経が光速についていけるとは思えませんけど?? | |

|

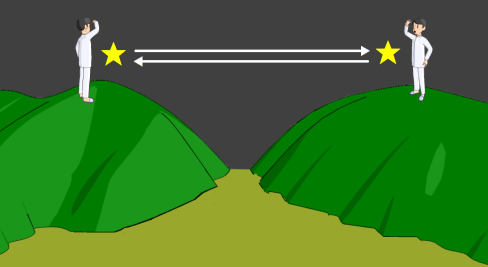

そのとおりです。この方法は上手くいきませんでした。でも、今の時代であればGalileoの方法はワケなくできます。

具体的にはTime of flight法と言うんですが、早い話、光をターゲットに向けて放射して、その散乱光を受光するまでの時間\(t\)を計測して、距離\(L\)(\(=\cfrac{ct}{2}\))を割り出すわけです。 図1.5.2 Time of flightの原理 | |

| 散乱光だと、受光される光エネルギーって、ほんの僅かしかないんじゃないですか?? | |

| なので、発光側の光出力が問題になります。これについては、ハイパワーの短パルス・レーザで解決できますね。もう1つは受光センサの感度ですが、これも性能が向上しているので、いいもの同士を組み合わせて、ビームをコリメートすれば200mくらいまでの測距が可能です。 | |

| 10cmの距離分解を得ようとすれば、0.67ns(=10cm×2/\(c\))で時間計測しないといけないですけど…。 | |

| それもNo problemですね。ps(ピコ秒)だ、fs(フェムト秒)だという単位は当たり前のご時世ですから、ちょろいです。 | |

| でも、コリメート光の行って帰ってだと、ターゲットの一部分の距離しか計測できないですよ。 | |

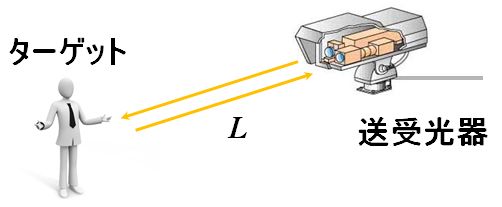

|

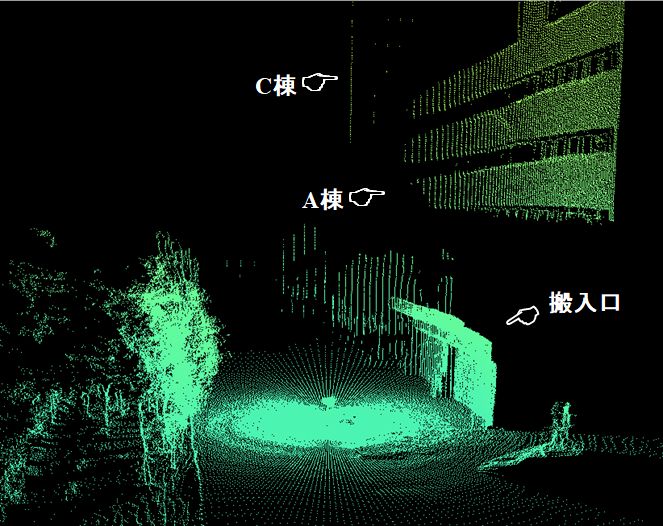

だから、ビームを振るんです。 図1.5.3 走査型LiDARの原理 ビームの方向\((\theta,\phi)\)と距離\(L\)が分かれば、極座標系で点群(ポイント・クラウド)データが得られるので、例えば図1.5.4のような画像が表示されます。  図1.5.4 ポイント・クラウド | |

| お~。何となく背景が分かりますね。Georges Seuratの点描画みたい。 | |

|

しかも、カメラ画像と同期させると、着色ポイント・クラウドも得られます。 図1.5.5 ポイント・クラウドとカメラ画像の合成 | |

| お~。これは綺麗~。 | |

| 図1.5.4や図1.5.5のポイント・クラウドは、私が開発のお手伝いをしたLiDAR(light detection and ranging)という装置で取得しています。 | |

| LiDARって、実用化はされているんですか?? | |

|

相鉄線の横浜駅を利用したときに、上を見ながら歩いてみてください。北陽電機㈱のLiDARが監視カメラとして採用されてますよ。 図1.5.6 LiDARの実例1(相鉄線の横浜駅構内にある北陽電機㈱製LiDAR) それと踏切にも設置されてますね。図1.5.7は㈱IHIのLiDARです。  図1.5.7 LiDARの実例2(踏切に設置された㈱IHI製LiDAR) | |

| 安全向けの装置ってイメージですね。 | |

| そうですね。ポイント・クラウドだと人物特定ができないので、プライバシー保護の観点からも印象がいいんですよ。危険かどうかを判断するのに、人物特定は必要ないですから。それと、究極の安全性向上となると、やはり自動車への転用でしょうね。 | |

|

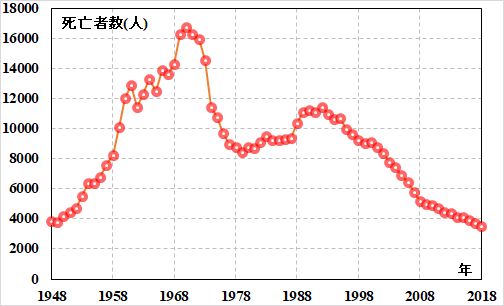

国内だと死亡者数は減少傾向にありますけど?? 図1.5.8 国内の交通事故による死亡者数 | |

| 確かにそうですが、絶対件数はまだ4桁ですしね。それと、この死亡者数は事故後24時間以内に死亡した人しかカウントされていない、ということも注意しないといけません。 | |

| え??じゃぁ、2日後に亡くなった人は?? | |

| カウントされていないです。 | |

| ということは、実質的にはもっと多いかもしれないってこと?? | |

| そうですね。だから、スマート・アシストとかって、どこの自動車メーカーでも宣伝してるでしょ?? | |

| そっかぁ。保険料も安くなりますもんね。LiDARの車載実績はあるんですか?? | |

|

ここまでで紹介した方式は、偏向ミラーを使ってビームを振る走査型と呼ばれているタイプですが、そのタイプだとフランスのValeo S.A.のLiDARが、Audi AGのA8に搭載されています。 図1.5.9 Valeo S.A.製LiDAR このLiDARが登場する前は非走査型タイプが主流で、㈱デンソーのLiDARがダイハツ工業㈱のムーヴに搭載されてますし、  図1.5.10 ㈱デンソー製LiDAR ドイツのContinental AGのLiDARがフォルクスワーゲンのアップに搭載されています。  図1.5.11 Continental AG製LiDAR | |

| 非走査型LiDARだと、空間のポイント・クラウドはどう取得されるんですか?? | |

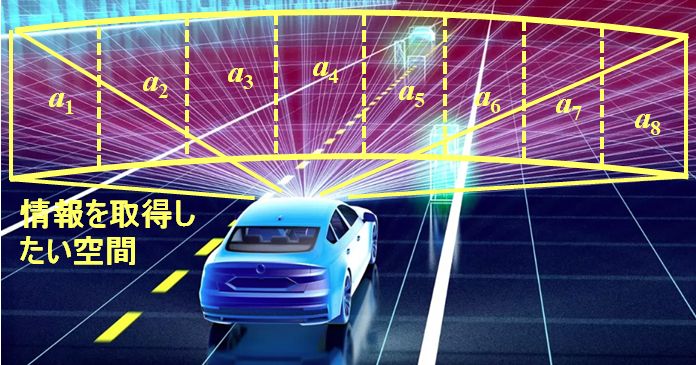

| 投光側のビームは、情報を取得するエリアをカバーできるように発散させます。そして、ターゲットからの散乱光を異なる受光センサでキャッチするんですよ。受光センサごとに、担当する空間のエリアが決まっているので、ざっくりとしたポイント・クラウドが得られます。 | |

|

投網みたいなイメージ?? 図1.5.12 非走査型LiDAR=投網?? | |

| まぁ、そう、なの、かな…?? | |

| そのタイプだと、ビームが発散する分、単位面積あたりのエネルギーが減って、近距離しか測定できないのでは?? | |

| はい。非走査型のデメリットの1つですね。 | |

| しかも、空間分解能は受光センサの数で決まりますよね?? | |

|

それも正解です。8個のセンサ・アレイが1列に並んでいるとして、 図1.5.13 リニア・アレイ型受光センサ(8分割タイプ) 空間を水平方向に120°の範囲で検知しようとすれば、15°の範囲にあるすべてのターゲットは、平均化された1つの距離情報として計測されることになります。つまり、水平角度分解能は15°ってことですね。  図1.5.14 非走査型LiDARではエリア分割して情報を取得する | |

| フワッとした情報しか得られないってことかぁ。 | |

| それと、いずれのLiDARにも共通の弱点があります。 | |

| 弱点?? | |

| 先ほど、走査型LiDARであれば200mくらいの測距が可能だと言いましたが、ターゲットが黒い服を着てたりすると、反射率が落ちるので測定可能距離は短くなります。また、ターゲットがツルツルの反射面だと散乱光が極端に減少するので測定が難しい。もちろん、細いターゲットや小さいターゲットも測定できません。加えて、環境の問題があります。 | |

| 環境の問題?? | |

| 例えば、野外で使う場合、太陽光が受光センサに入射してしまうと、肝心の散乱光が埋もれてしまいます。また、雨とか霧といった環境下では、その先にあるターゲットまでビームが届かなかったりね。 | |

| う~ん。あまり解決できそうな予感がしないですけど。 | |

| なので、LiDARだけで何もかもやるのは無理ということです。他のセンサでお互いの欠点をカバーしたり、適材適所で使うことが重要でしょう。 | |

| そういう装置がいろいろ揃って、自動運転車って流れですね。 | |

|

まぁ、そういうことになるでしょう。それと、Time of flight法の応用例ということでは、ゲーム機がありますね。 図1.5.15 Kinect | |

| Kinectか!! | |

| はい。Xbox向けのゲーム・デバイスですが、2013年に発売された第2世代がTime of flight法でモーション・キャプチャーをしているはずです。 | |

| 第1世代は?? | |

| パターン投影法という別の方式を採用してました。そうそう。それと、2012年にMITが同じ原理を利用して、角を曲がった先を撮影できるカメラを開発したっていうのでニュースになりましたね。 | |

| 角を曲がった先??さすがに、それは無理では?? | |

|

このカメラは、1982年に公開された『ブレード・ランナー』というSF映画で登場しましたが、 これを視聴した科学者・専門家から「今後いくら技術が進んでも原理的に不可能」と失笑を買ったという、いわくつきの技術です。もちろん、何の仕掛けもなければ光は直進していくだけなので無理なんですが、壁からの反射を利用すれば可能でしょ?? 寧ろ、この技術は戻ってきたビームとターゲットを対応づけるアルゴリズムが最大の課題です。 | |

| なるほど~。考えましたねぇ。 | |

| こんな具合に、Galileoのアイデアは、もう当たり前のように使われているってことなのです。 |

| 前頁へ | 戻る | 次頁へ |